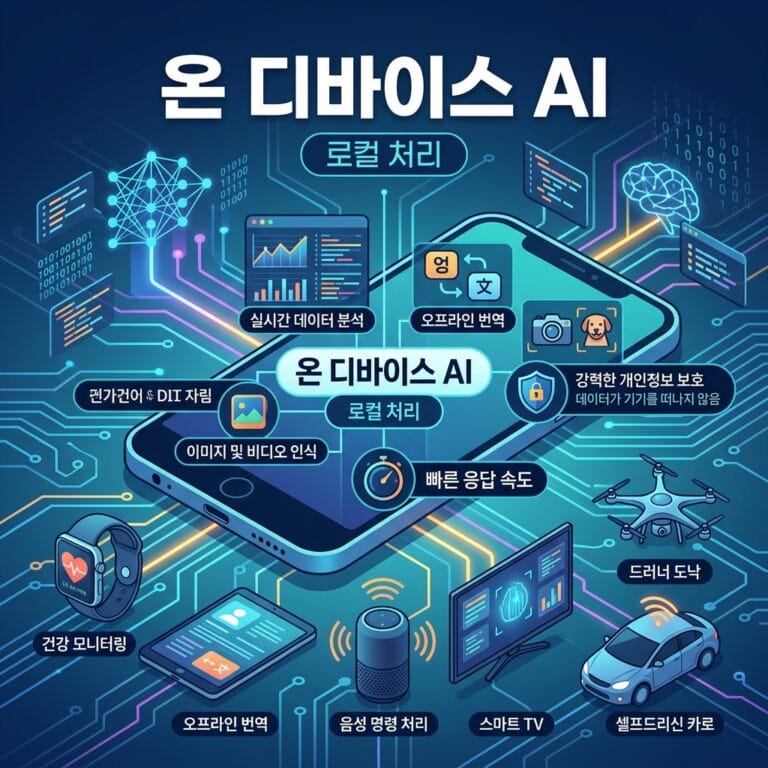

로컬 LLM은 대형 언어 모델을 클라우드가 아니라 개인 PC나 사내 장비에서 직접 실행하는 방식을 뜻합니다. 요즘 이 키워드가 관심을 받는 이유는 단순히 AI를 내 컴퓨터에서 돌린다는 재미 때문만은 아닙니다. 개인정보 보호, 비용 통제, 오프라인 사용, 내부 문서 처리 같은 현실적인 장점이 있기 때문입니다. 다만 로컬 LLM은 장점만큼 한계도 분명해서, 어떤 상황에서 적합하고 어디서부터 클라우드가 더 나은지를 함께 봐야 제대로 이해할 수 있습니다.

목차

- 로컬 LLM이 주목받는 이유

- 로컬 LLM과 클라우드 LLM 비교 표

- 로컬 LLM이 잘 맞는 사용 장면

- 로컬 LLM 시작 전 체크포인트

로컬 LLM이 주목받는 이유

핵심 요점: 로컬 LLM은 데이터 통제와 비용 예측성 측면에서 강하지만, 성능과 편의성에서는 클라우드 대비 제약이 있을 수 있습니다.

클라우드 기반 LLM은 시작이 쉽고 성능이 뛰어난 경우가 많지만, 데이터를 외부로 보내야 하고 사용량이 늘수록 비용도 계속 발생합니다. 반면 로컬 LLM은 초기 세팅이 필요하지만, 한번 환경을 갖추면 내부 문서 실험이나 반복 테스트를 더 편하게 할 수 있습니다. 특히 외부 전송이 민감한 조직에서는 로컬 LLM이 꽤 현실적인 대안으로 검토됩니다.

물론 모든 사용자가 로컬 LLM을 써야 하는 것은 아닙니다. 고성능 GPU가 필요한 경우도 있고, 최신 모델 성능을 그대로 기대하면 실망할 수 있습니다. 그래서 중요한 건 “로컬이냐 클라우드냐” 자체보다, 내가 어떤 목적 때문에 직접 돌리고 싶은지를 먼저 정하는 것입니다.

로컬 LLM을 찾는 대표 이유

- 내부 데이터나 민감한 문서를 외부로 보내기 부담스러울 때

- API 비용 없이 반복 실험을 하고 싶을 때

- 오프라인 환경에서도 AI를 쓰고 싶을 때

- 모델 구조와 세팅을 직접 만져보고 싶을 때

로컬 LLM과 클라우드 LLM 비교 표

비교 포인트: 로컬 LLM은 통제력, 클라우드 LLM은 편의성과 성능이 강점입니다. 실제 선택은 목적과 환경에 따라 달라집니다.

로컬 LLM이 잘 맞는 사용 장면

실전 팁: 로컬 LLM은 최고 성능 경쟁보다, 특정 목적에 맞는 안정적 실험 환경을 만드는 쪽에서 가치가 큽니다.

예를 들어 개발자가 코드를 로컬에서 요약하거나, 사내 문서를 외부 전송 없이 정리하거나, 개인 프로젝트에서 반복 프롬프트 실험을 하는 데는 로컬 LLM이 잘 맞습니다. 또 인터넷 연결 없이도 작동해야 하는 환경이라면 로컬 실행의 장점이 분명해집니다.

반면 고객 대상 서비스나 대규모 사용자 대응처럼 안정성과 확장성이 중요한 경우는 클라우드 기반이 더 편할 수 있습니다. 그래서 로컬 LLM은 “대체재”보다는 “목적형 선택지”로 보는 편이 현실적입니다.

로컬 LLM 시작 전 체크포인트

- 장비 성능과 메모리가 충분한가

- 정말 외부 전송이 어려운 데이터가 있는가

- 최신 최고 성능보다 통제력이 더 중요한가

- 운영과 업데이트를 직접 감당할 수 있는가

📌 포스팅 핵심 요약

로컬 LLM의 핵심은 내 환경에서 데이터를 더 통제하며 반복 실험할 수 있다는 점이고, 대신 성능과 운영 편의성에서는 클라우드보다 제약이 있을 수 있습니다.

- 외부 전송이 민감한 데이터 처리에 유리합니다.

- 초기 세팅과 장비 요구사항은 분명히 존재합니다.

- 모든 경우의 정답이 아니라 목적형 선택지입니다.

- 비용, 성능, 통제력의 균형을 먼저 따져야 합니다.

#생성형AI

#온디바이스AI

#AI보안

#개발생산성